Google Colabで使われているgpuの種類の調査

はじめに

Google ColaboratoryにはGPUガチャがあるよという話 - Qiita

この記事読んで、google colabのgpuでも色々な種類のものがあることを知った。

画像や動画でdeep learningをする時、gpuの性能が重要なことが多い。 deep learningの学習は、多くの時間がかかり、 google colabは、時間制限がある。 そのため学習時は、出来るだけ性能のいいgpuを使いたい。 そこで、どのようなgpuがあるのかを調べてみた。

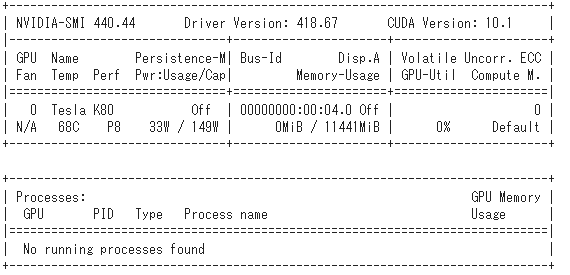

調べ方は簡単で、コマンド!nvidia-smi名前長くて見れないやつは!nvidia-smi -Lで

gpuの名前見て、その名前を検索して調べた。

このコマンドは、gpuの名前や使用率を見ることができるコマンドで、よくgpu使用率を見る時に

使用している。

gpuの調査

gpuの種類

実際にgoogle colabを使っていて、割り当てられたものは下のようになった。

自分でgoogle colabを使用していたが、割り当てられたのを見たことがない、未確認のものは下のようになった。

- Tesla T4

全てNvidia Teslaシリーズであった。

短くにまとめてみる。 注意点としては、Tesla K80は2つのgpuのうち1つのみ使えるらしく、Nvidiaの実際のスペック表に書いてあるものの半分だけ使えると思われる。 下の表には半分にした値を載せた。

| GPU名前 | 発売日 | メモリ容量 | CUDAコアプロセッサ数 | 単精度浮動小数点性能 | |

|---|---|---|---|---|---|

| Tesla K80 | 2014年11月 | 12GB | 2496 コア | 4.37 TFLOPS (GPU Boost Clocks), 2.8 TFLOPS (Base Clocks) | |

| Tesla P100-PCIE-16GB | 2016年6月 | 16GB | 3584 コア | 9.3 TFLOPS(最大ブースト) | |

| Tesla P4 | 2016年9月 | 8GB | 2560 コア | 5.5 TFLOPS(最大ブースト) |

wikipediaを参考にした。

この表を見てみると、メモリ容量に関しては、P100がP4の2倍の16GBもあり、かなり容量が多い。 deep learningでは、メモリを多く使うのでこれはうれしい。コア数でも、やはりP100が多い。 なので、計算速度もP100が速いと思われる。K80とP4は、どちらが速いのかはわからない。

GeForceシリーズと比較

Teslaシリーズは、普段は見ることがないので、よく見る方のgeforceシリーズと比べてみる。 TeslaシリーズのP100と比較した。 GeForceシリーズは、最近のものだとRTX 2080 super,RTX 2070 superなどや、前に売られていたGTX 1080などのシリーズ。

| GPU名前 | 発売日 | メモリ容量 | CUDAコアプロセッサ数 | 単精度浮動小数点性能 | |

|---|---|---|---|---|---|

| Tesla P100-PCIE-16GB | 2016年6月 | 16GB | 3584 コア | 9.3 TFLOPS(最大ブースト) | |

| RTX 2080 Ti | 2018年8月 | 11GB | 4352 コア | 12.4 TFLOPS | |

| RTX 2070 SUPER | 2019年7月 | 8GB | 2560 コア | 8.2 TFLOPS |

wikipediaを参考にした。

P100と比べると、GeForce RTX 2080 Tiはメモリが5GBほど少ないが、P100より新しいのでコア数は多く演算は早いと思われる。

nvidia-smiで取得したSS

おわりに

google colabで使われているgpuの種類をnvidia-smiのコマンドを使って、名前を調べると、

NVIDIA Teslaシリーズのgpuが使われていることがわかった。

さらに、割り当てられたことのある3つのgpuについて、性能やメモリ容量などをまとめてみた。

メモリでは、P100>K80>P4の順で容量が大きく、P100がP4の2倍の16Gとかなり大きい。 計算速度もP100が速い。K80とP4は、どちらが速いのかはわからない。

無料で使わせてもらえるのはとてもありがたい。 ありがたく使わせてもらいますm( )m。

新しいの見つけたら更新していきます。